Regulasi kercerdasan buatan merupakan suatu peraturan untuk mengatur penggunaan kecerdasan buatan agar tidak digunakan secara ilegal dan sewenang-sewenang. Saat ini penggunaan dan pengembangan AI mulai berkembang. Tentu saja, hal itu akan membuka peluang kreasi, inovasi dan penyelesaian dari berbagai isu-isu kontemporer AI (Artificial Intelegence) secara kolaboratif. Terdapat 6 (enam) isu kontemporer AI secara kolaboratif yaitu privasi atau kerahasiaan, toxicity atau ancaman berbasis siber, perlindungan hak cipta, bias implementasi AI, dan pemahaman nilai kemanusiaan. Kecerdasan buatan ini tidak hanya bisa berdampak positif tetapi bisa berdampak negatif pula. Penggunaan AI bisa menjadi berbahaya dan mengancam jika AI ini digunakan secara ilegal dan tidak dibatasi sampai sejauh mana AI ini bisa dikembangkan.

Sumber: Lihat artikel asli di Wikipedia

Artikel ini perlu dikembangkan dari artikel terkait di Wikipedia bahasa Inggris. (Desember 2023)

klik [tampil] untuk melihat petunjuk sebelum menerjemahkan.

|

Regulasi kercerdasan buatan merupakan suatu peraturan untuk mengatur penggunaan kecerdasan buatan agar tidak digunakan secara ilegal dan sewenang-sewenang. Saat ini penggunaan dan pengembangan AI mulai berkembang. Tentu saja, hal itu akan membuka peluang kreasi, inovasi dan penyelesaian dari berbagai isu-isu kontemporer AI (Artificial Intelegence) secara kolaboratif. Terdapat 6 (enam) isu kontemporer AI secara kolaboratif yaitu privasi atau kerahasiaan, toxicity atau ancaman berbasis siber, perlindungan hak cipta, bias implementasi AI, dan pemahaman nilai kemanusiaan. Kecerdasan buatan ini tidak hanya bisa berdampak positif tetapi bisa berdampak negatif pula. Penggunaan AI bisa menjadi berbahaya dan mengancam jika AI ini digunakan secara ilegal dan tidak dibatasi sampai sejauh mana AI ini bisa dikembangkan.

Menurut AI Index 2025 dari Universitas Stanford, penyebutan AI dalam legislasi meningkat 21,3 persen di 75 negara sejak 2023. Angka ini merupakan kenaikan sembilan kali lipat sejak 2016. Lembaga federal Amerika Serikat memperkenalkan 59 regulasi terkait AI pada 2024, lebih dari dua kali jumlah pada 2023. Pada 2024, hampir 700 rancangan undang-undang terkait AI diajukan di 45 negara bagian, naik dari 191 pada 2023.[1][2]

Saat ini belum ada kesepakatan luas mengenai tingkat atau mekanisme pengaturan AI. Beberapa tokoh penting di bidang ini, termasuk Elon Musk, Sam Altman, Dario Amodei, dan Demis Hassabis, mengimbau diberlakukannya regulasi segera. Pada 2023, setelah terciptanya ChatGPT-4, Elon Musk dan sejumlah pihak menandatangani surat terbuka yang menyerukan penundaan pelatihan sistem AI yang lebih kuat. Tokoh lain seperti Mark Zuckerberg dan Marc Andreessen memperingatkan risiko regulasi dini yang dapat menghambat inovasi.[3][4]

Survei Ipsos tahun 2022 menunjukkan perbedaan sikap yang besar antarnegara. Sebanyak 78 persen warga Tiongkok setuju bahwa produk dan layanan berbasis AI memberikan lebih banyak manfaat dibandingkan kerugiannya. Di Amerika Serikat hanya 35 persen yang setuju. Survei Ipsos juga menunjukkan 61 persen warga Amerika setuju dan 22 persen tidak setuju bahwa AI menimbulkan risiko bagi umat manusia. Dalam jajak pendapat Fox News tahun 2023, 35 persen warga Amerika menilai sangat penting dan 41 persen menilai cukup penting bagi pemerintah federal untuk mengatur AI. Sebanyak 13 persen menjawab tidak terlalu penting dan 8 persen menjawab tidak penting sama sekali.[5]

Pada 2023, Inggris memulai rangkaian konferensi internasional tentang AI melalui AI Safety Summit. Kegiatan ini berlanjut dengan AI Seoul Summit pada 2024 dan AI Action Summit di Paris pada 2025.[6][7]

Regulasi kecerdasan buatan adalah pengembangan kebijakan dan hukum sektor publik untuk mendorong serta mengatur AI.[8] Pertimbangan administrasi publik dan kebijakan umumnya berfokus pada implikasi teknis dan ekonomi serta pada sistem AI yang tepercaya dan berpusat pada manusia.[9] Fokus lainnya mencakup regulasi kecerdasan buatan tingkat super, risiko dan bias dalam algoritma pembelajaran mesin, keterjelasan keluaran model, dan ketegangan antara AI sumber terbuka dan penggunaan AI tanpa pengawasan.[10]

Terdapat usulan hukum keras maupun hukum lunak untuk mengatur AI. Sejumlah pakar hukum mencatat bahwa pendekatan hukum keras menghadapi tantangan besar.[11] Teknologi AI berkembang sangat cepat sehingga menimbulkan masalah kecepatan karena hukum tradisional sering tidak mampu mengikuti aplikasi baru beserta risiko dan manfaatnya. Keragaman aplikasi AI juga menjadi tantangan bagi lembaga regulasi yang memiliki cakupan yurisdiksi terbatas.[12] Sebagai alternatif, beberapa pakar hukum berpendapat bahwa pendekatan hukum lunak lebih menjanjikan karena memberi fleksibilitas untuk menyesuaikan diri dengan perkembangan teknologi dan perubahan penggunaan AI. Namun pendekatan hukum lunak sering tidak memiliki kekuatan penegakan yang memadai.[13]

Cason Schmit, Megan Doerr, dan Jennifer Wagner mengusulkan pembentukan regulator kuasi-pemerintah dengan memanfaatkan hak kekayaan intelektual seperti lisensi copyleft pada objek AI tertentu seperti model dan kumpulan data pelatihan serta mendelegasikan hak penegakan kepada entitas penegak yang ditunjuk. Mereka berpendapat bahwa AI dapat dilisensikan dengan syarat kepatuhan pada praktik etis dan kode etik tertentu seperti prinsip hukum lunak.[14]

Organisasi pemuda yang berfokus pada AI seperti Encode Justice juga mengeluarkan agenda komprehensif yang menyerukan regulasi AI yang lebih ketat dan kemitraan publik swasta.[15][16]

Regulasi AI dapat didasarkan pada prinsip dasar. Tinjauan meta tahun 2020 dari Berkman Klein Center for Internet and Society terhadap prinsip yang sudah ada seperti Asilomar Principles dan Beijing Principles mengidentifikasi delapan prinsip utama yaitu privasi, akuntabilitas, keselamatan dan keamanan, transparansi dan keterjelasan, keadilan dan non-diskriminasi, kendali manusia atas teknologi, tanggung jawab profesional, serta penghormatan terhadap nilai manusia. Hukum dan regulasi AI dibagi menjadi tiga pokok utama yaitu tata kelola sistem kecerdasan otonom, tanggung jawab dan akuntabilitas sistem, serta isu privasi dan keselamatan.[17] Pendekatan administrasi publik melihat hubungan antara hukum dan regulasi AI, etika AI, dan masyarakat AI yang mencakup substitusi dan transformasi tenaga kerja, penerimaan sosial dan kepercayaan pada AI, serta perubahan interaksi manusia dan mesin. Pengembangan strategi sektor publik untuk pengelolaan dan regulasi AI dianggap perlu pada tingkat lokal, nasional, dan internasional serta di berbagai bidang mulai dari manajemen pelayanan publik dan akuntabilitas hingga penegakan hukum, layanan kesehatan terutama konsep Human Guarantee, sektor keuangan, robotika, kendaraan otonom, militer dan keamanan nasional, serta hukum internasional.[18]

Henry Kissinger, Eric Schmidt, dan Daniel Huttenlocher menerbitkan pernyataan bersama pada November 2021 berjudul Being Human in an Age of AI yang menyerukan pembentukan komisi pemerintah untuk mengatur AI.[19]

Pada 2025, pemerintah Inggris dan Amerika Serikat menolak menandatangani perjanjian internasional tentang AI pada AI Action Summit di Paris. Perjanjian tersebut digambarkan sebagai usulan pendekatan terbuka, inklusif, dan etis dalam pengembangan AI termasuk langkah perlindungan lingkungan. Wakil Presiden AS JD Vance berpendapat bahwa perjanjian itu akan merugikan pertumbuhan industri AI. Pemerintah Inggris menambahkan bahwa perjanjian tersebut tidak memberikan kejelasan praktis tentang tata kelola global maupun cukup membahas isu yang lebih sulit terkait keamanan nasional.[20]

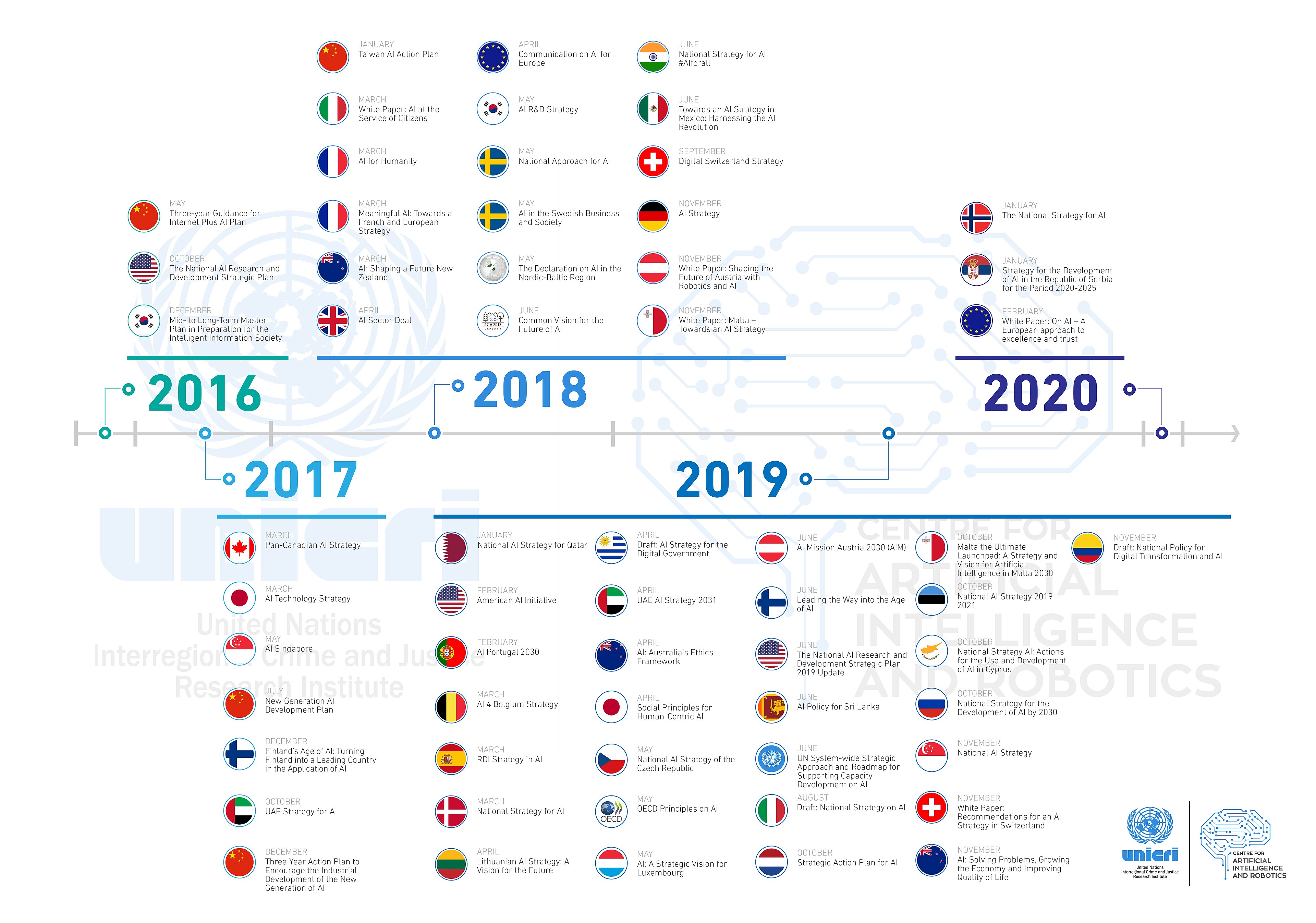

Lanskap kebijakan dan regulasi untuk AI sendiri adalah salah satu masalah yang muncul di yuridiksi reginal maupun nasional secara global. Misalnya di Uni Eropa dan Rusia. Sejak awal tahun 2016, banyak otoritas nasional, regional, dan internasional mulai mengadopsi strategi, rencana aksi, dan makalah kebijakan tentang AI. Dokumen-dokumen ini mencakup berbagai topik seperti regulasi dan tata kelola, serta strategi industri, penelitian, talenta, dan infrastruktur.[1]

Berbagai negara di dunia mulai mendekati masalah ini dengan cara yang berbeda. Mengenai tiga negara dengan ekonomi terbesar, dikatakan bahwa Amerika Serikat mengikuti pendekatan yang digerakkan oleh pasar, Cina mengedepankan pendekatan yang digerakkan oleh negara, dan Uni Eropa mengupayakan pendekatan yang digerakkan oleh hak.

Di Indonesia sendiri saat ini belum ada peraturan yang secara khusus untuk regulasi kecerdasan buatan. Namun, dasar hukum yang salah satunya berkaitan dengan regulasi kecerdasan buatan ini adalah UU No. 28 Tentang Hak Cipta.[2] Pemerintah Indonesia masih merujuk pada Dokumen Strategi Nasional Kecerdasan Artifisial sebagai acuan dalam penggunaan AI (Artificial Intelegence). Berdasarkan siaran pers Kominfo di bulan Agustus 2023 lalu telah membahas perihal perluasan kecerdasan buatan, kominfo mulai menyiapkan regulasi kecerdasan buatan dan juga menyiapkan sumberdaya yang memadai[3]